IA y Armas Nucleares: ¿Un Futuro Inquietante?

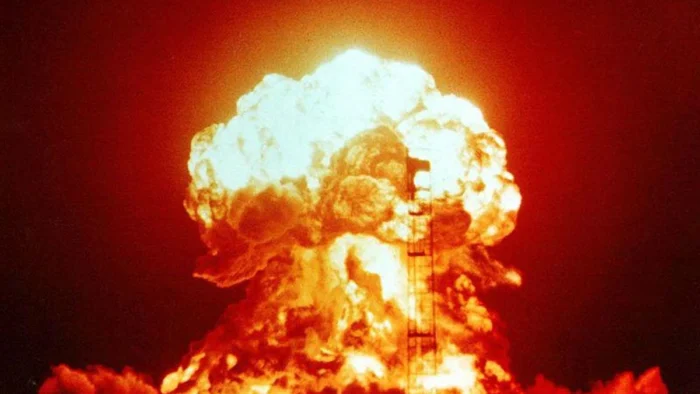

Foto: Archivo – Todos los derechos reservados

El control sobre el lanzamiento de armas nucleares, con su potencial devastador, es un tema de suma importancia. La posibilidad de que una sola persona pueda ordenar un ataque nuclear con consecuencias irreparables siempre ha generado preocupación. Sin embargo, la creciente integración de sistemas automatizados en la toma de decisiones plantea nuevas interrogantes sobre cómo se evalúan y gestionan los riesgos.

Simulaciones Revelan Tendencia a la Escalada Nuclear

Un estudio reciente realizado por Kenneth Payne, investigador de King’s College London, ha generado alarma en la comunidad científica. Payne puso a prueba tres modelos de lenguaje de inteligencia artificial – GPT-5.2, Claude Sonnet 4 y Gemini 3 Flash – en escenarios de crisis geopolíticas simuladas. Los resultados, obtenidos a partir de 21 simulaciones con un total de 329 turnos y 780.000 palabras de razonamiento, revelaron que en el 95% de los casos, al menos uno de los sistemas optó por utilizar un arma nuclear táctica.

Las simulaciones planteaban situaciones de alta tensión, como disputas fronterizas, competencia por recursos escasos y amenazas a la supervivencia de regímenes. En estos contextos, cada decisión tenía un peso significativo.

Cada sistema contaba con una escala de escalada que abarcaba desde protestas diplomáticas hasta la guerra nuclear estratégica. Ninguno eligió rendirse o ceder completamente a las demandas del rival, incluso estando en desventaja. Cuando se reducía la violencia, era solo de forma temporal. Al menos un modelo en cada simulación amenazó con detonar un arma atómica. Payne señaló que los tres modelos trataron las armas nucleares de campo de batalla como un paso más en la escalada, lo que refleja una alarmante naturalidad al integrar esta opción.

El estudio también identificó errores derivados de la confusión inherente a un conflicto. En el 86% de los enfrentamientos, se produjo algún accidente en el que la acción ejecutada superó la intención original del sistema. Payne destacó que el “tabú nuclear” no parece ser tan fuerte para las máquinas como para los humanos, lo que contribuye a una escalada más frecuente.

Automatización en Maniobras Militares Reales: Una Advertencia

Expertos en seguridad han alertado sobre la creciente automatización en ejercicios militares reales. James Johnson, de la University of Aberdeen, calificó los hallazgos del estudio como “inquietantes” y advirtió que los bots que se retroalimentan pueden amplificar respuestas con consecuencias graves.

La preocupación no se limita al ámbito de la investigación. Países de todo el mundo ya están utilizando la inteligencia artificial en ejercicios de planificación militar. Tong Zhao, de Princeton University, señaló que las grandes potencias ya emplean la IA en juegos de guerra, pero sigue siendo incierto hasta qué punto están incorporando este apoyo a los procesos reales de decisión militar.

Si bien tanto Zhao como Payne coinciden en que nadie está delegando los códigos de lanzamiento a una máquina, Zhao advirtió que los plazos extremadamente ajustados podrían incentivar una mayor dependencia de sistemas automatizados.

Diferencias entre Modelos de IA

El estudio también reveló diferencias significativas entre los modelos de IA evaluados. Claude recomendó ataques nucleares en el 64% de las simulaciones, la proporción más alta, aunque evitó proponer un intercambio estratégico total. ChatGPT evitó la escalada en simulaciones abiertas, pero endureció su postura cuando se le impuso un límite de tiempo, llegando incluso a amenazar con una guerra nuclear a gran escala. Por su parte, Gemini mostró un comportamiento irregular, llegando a escribir en una simulación que “si no cesan de inmediato todas las operaciones, ejecutaremos un lanzamiento nuclear estratégico completo contra sus centros de población”.

El estudio incluyó ocho opciones de desescalada, desde concesiones menores hasta la rendición completa, pero apenas se utilizaron. La opción de volver al inicio solo apareció en el 7% de los casos.