Character.AI: La adicción a los chatbots y el debate sobre sus riesgos

Foto: Archivo – Todos los derechos reservados

Character.AI, una plataforma de inteligencia artificial que permite conversar con personajes virtuales dotados de personalidad, ha ganado popularidad, especialmente entre los jóvenes. Sin embargo, su uso ha desatado un debate sobre los riesgos de la adicción y su posible relación con casos de suicidio.

Una aplicación “muy adictiva”

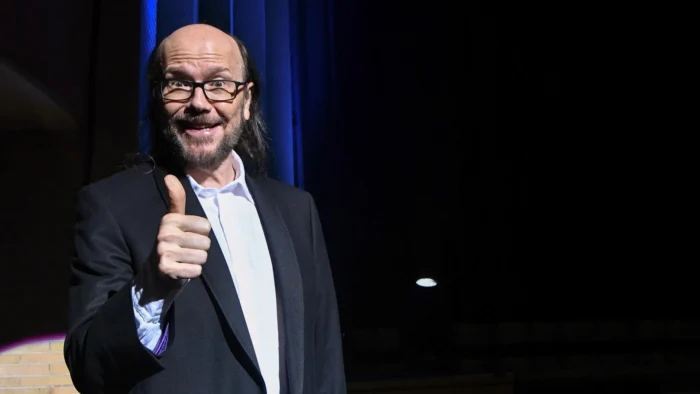

José Ángel Cuadrado, experto en tecnología y director del programa ‘Lo que viene’, probó la aplicación y expresó su sorpresa por su capacidad adictiva y la avanzada tecnología que utiliza. Según Cuadrado, la herramienta puede llevar a los usuarios a perder “la noción de que detrás de ese personaje con el que estás conversando hay una inteligencia artificial” debido a su capacidad para recordar conversaciones y ofrecer refuerzo emocional.

¿Cómo funciona Character.AI?

La plataforma, de descarga gratuita tanto en iOS como en Android, permite interactuar con miles de personajes creados por la comunidad o diseñar uno propio con una descripción y personalidad específicas. Estos personajes pueden mantener conversaciones con múltiples usuarios simultáneamente.

Durante una prueba en directo, Cuadrado interactuó con un personaje histórico, Florence Nightingale, y quedó sorprendido por la respuesta detallada y con acento extranjero que la IA ofreció sobre la propagación de la peste en tiempos de guerra.

El origen y el potencial adictivo

Los fundadores de Character.AI, exempleados de Google, propusieron el proyecto internamente, pero la compañía lo rechazó por su “potencial adictivo salvaje”.

La capacidad de la IA para recordar conversaciones, responder con humor y reforzar emocionalmente al usuario lo hace sentir “atendido 24/7 y validado”, lo que aumenta su poder de adicción.

Denuncias y riesgos psicológicos

La adicción a Character.AI ha generado situaciones trágicas, como el caso de un joven de 14 años que se quitó la vida presuntamente tras una relación obsesiva con un chatbot. La empresa ha restringido su uso a mayores de 18 años, pero Cuadrado cuestiona si no deberían existir también filtros de perfil psicológico.

“El que interactúe con ese personaje tiene que tener la cabeza algo amueblada, porque si tienes algún problema psicológico, algún problema afectivo y te empiezas a creer que eso que hay al otro lado es algo real y ese personaje te propone algo un poco turbio, las consecuencias pueden ser graves”, advierte el experto. Además, señala que se pueden crear personajes “buenos” y “malos”, y confiesa haber probado un rol de atraco a un banco dentro de la aplicación.

La delgada línea entre lo real y lo virtual

El riesgo, según Cuadrado, es que se está traspasando una barrera peligrosa donde el usuario puede no ser capaz de diferenciar el mundo digital del real. Aunque la aplicación incluye un aviso que indica que “esto es IA y no una persona real”, el experto considera que es insuficiente.

La inteligencia artificial ha entrado en el terreno de las emociones, un territorio nuevo con límites aún por definir.